在AI公司冲刺IPO的关键时期,一次源代码泄露事件及其后续的‘误伤’操作,将Anthropic推向了舆论的风口浪尖。市场消息显示,该公司在试图清理其热门产品Claude Code意外泄露的源代码时,向代码托管平台GitHub提交了大规模的下架通知,导致超过8000个代码仓库被波及,其中甚至包括其官方公开仓库的合法分支。这一事件不仅暴露了AI公司在知识产权保护与合规操作上的脆弱性,也为整个高速发展的AI行业敲响了安全警钟。

源代码泄露与大规模‘误伤’始末

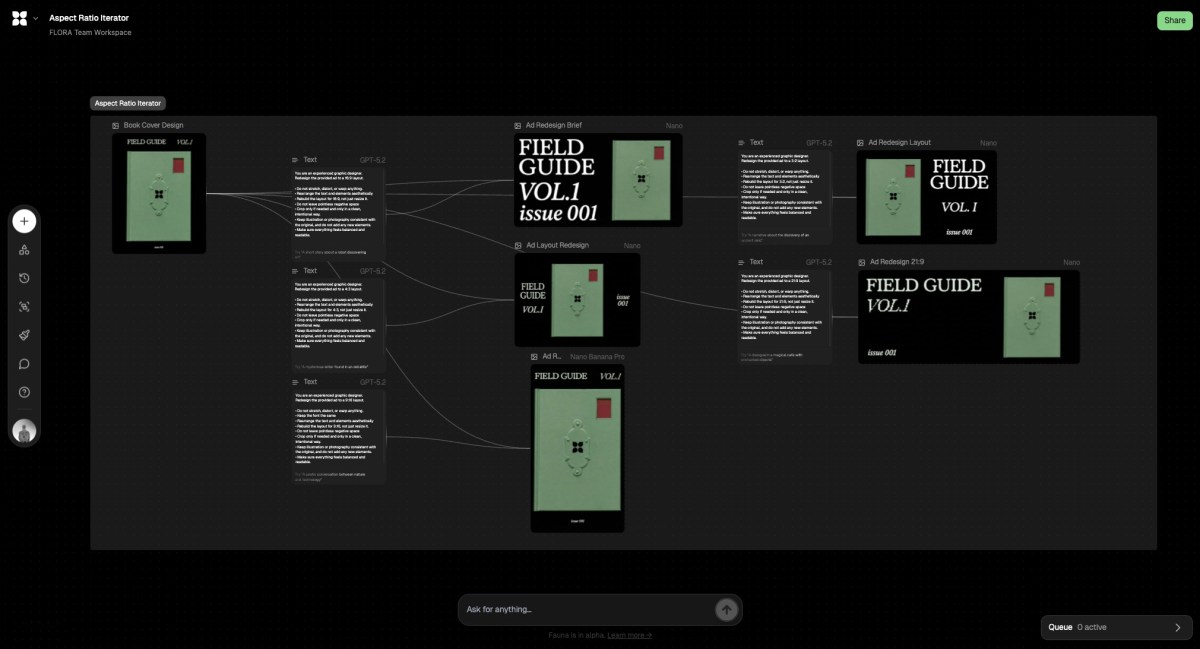

据熟悉内情的人士透露,此次事件的导火索源于Anthropic近期的一次产品发布。一位软件工程师发现,Claude Code命令行应用程序的源代码被意外包含在了发布包中。Claude Code是Anthropic基于其大语言模型(Large Language Model, LLM)开发的、在代码生成领域处于领先地位的工具。其源代码的泄露,意味着外界得以一窥Anthropic如何利用底层LLM构建应用的核心技术细节。

发现泄露后,AI开发社区迅速行动,相关代码被广泛分享至GitHub。为控制影响,Anthropic依据美国数字版权法(DMCA)向GitHub发出了下架通知。然而,问题在于通知的执行范围出现了严重偏差。最新行业动态指出,该通知最终被应用于大约8100个仓库,远超出包含泄露代码的原始仓库范围。大量开发者发现,自己合法分叉(Fork)的Anthropic官方公开仓库也遭到封禁,引发了社区的强烈不满。

面对舆论压力,Anthropic方面迅速做出回应。Claude Code项目负责人Boris Cherny承认此次操作是意外,并撤回了大部分下架通知,最终将范围限定在包含泄露源代码的1个原始仓库及其96个分支上。该公司发言人在一份声明中解释称:“通知中提及的仓库与我们自己的公共Claude Code仓库所在的分叉网络相连,因此下架波及了超出预期的仓库。我们已经撤回了除指定仓库外的所有通知,GitHub也已恢复受影响分支的访问权限。”

技术背景:Claude Code与AI代码生成赛道

要理解此次泄露的严重性,必须先了解Claude Code在AI代码生成领域的地位。作为Anthropic旗下明星AI助手Claude的垂直应用,Claude Code专为开发者设计,能够理解自然语言指令并生成、解释或调试代码。其核心竞争力在于背后强大的Claude系列大语言模型,该模型以出色的逻辑推理、低幻觉率和强大的上下文处理能力著称。

在竞争激烈的AI编程助手市场,Claude Code的主要对手包括GitHub Copilot(基于OpenAI的模型)、Amazon CodeWhisperer以及众多初创公司的产品。源代码的泄露,可能让竞争对手有机会分析其提示工程(Prompt Engineering)、模型微调策略以及安全防护机制,从而削弱Anthropic的技术壁垒。这起事件也凸显了AI公司一个普遍的管理挑战:在追求快速迭代和开源协作(如公开部分代码以构建生态)的同时,如何精准地保护最核心的商业机密。

行业影响与未来展望:安全合规成IPO前必修课

这次‘误伤’式的清理行动,发生在Anthropic被传正筹备首次公开募股(IPO)的敏感时期,无疑为其公司治理和风险控制能力蒙上了一层阴影。对于一家即将成为公众公司的AI企业而言,执行力的精确度和合规操作的严谨性是投资者评估其价值的关键维度。源代码的意外泄露本身已属重大运营事故,而后续补救措施引发的二次风波,则进一步放大了外界对其内部流程的质疑。

有行业分析师指出,此事件可能带来多重连锁反应:首先,它可能促使所有AI公司重新审视其代码发布和知识产权保护流程,加强内部审计和自动化检查工具的使用。其次,对于GitHub等开源平台,如何更精细地处理来自大型科技公司的DMCA下架请求,平衡版权保护与开发者社区的创新活力,将成为一个更紧迫的议题。最后,对于Anthropic自身,除了技术上的修复,如何重建开发者社区的信任,将是比修复代码漏洞更艰巨的任务。

长远来看,随着AI技术日益成为基础设施,其安全性、稳定性和透明度的要求将水涨船高。任何一家志在成为行业领导者的公司,都必须将安全与合规内化为核心能力。此次Anthropic的风波,为整个行业上了一堂生动的‘危机管理’课,也预示着在AI军备竞赛的下半场,稳健的运营或将比激进的技术突破更能赢得市场的长期信心。

相关文章