人工智能的算力瓶颈正迎来一次关键性突破。最新行业动态指出,一项名为TurboQuant的新型AI内存压缩算法被披露,该技术宣称能将大型语言模型在推理阶段的工作内存(KV Cache)占用减少至少6倍,且不损失模型精度。这一突破若成功落地,将直接降低AI应用的运行成本,并缓解当前AI硬件面临的内存压力。

技术核心:量化压缩如何攻克内存瓶颈

据熟悉内情的人士透露,TurboQuant的核心在于一种创新的向量量化(Vector Quantization)方法。在AI推理过程中,模型需要将之前生成的文本(即键值对,Key-Value Pair)存储在KV缓存(KV Cache)中,以供后续生成时参考。随着生成长度的增加,这个缓存会急剧膨胀,成为制约推理速度和增加内存成本的主要瓶颈。

TurboQuant通过其核心的PolarQuant量化方法与名为QJL的训练优化技术,对KV缓存中的向量进行高效压缩。简单来说,它将高精度的浮点数表示,转换为一种信息密度更高、占用空间更少的离散表示形式,从而在几乎不影响模型输出质量的前提下,大幅缩减内存占用。该公司在一份最新文件中披露,这项技术计划在下月的顶级学术会议ICLR 2026上正式公布。

行业反响:效率革命与“现实版Pied Piper”

此消息一出,迅速在技术社区引发热议。由于其“极致压缩且无损”的特性,许多业内人士联想到了HBO经典剧集《硅谷》中虚构的创业公司Pied Piper及其革命性的压缩算法。市场观察人士指出,这种类比反映了业界对能从根本上提升计算效率的底层技术的渴望。

更有行业领袖将此次突破与近期备受关注的DeepSeek模型相提并论。后者以其“用更少算力实现强大性能”的高效训练路径而闻名。有评论认为,TurboQuant在推理端的效率优化,与DeepSeek在训练端的成本控制,共同指向了AI发展的下一个关键战场:极致性价比。云服务商Cloudflare的CEO甚至在社交媒体上评论称,这为AI推理在速度、内存占用和功耗方面的优化“打开了巨大的空间”。

技术背景:为何KV缓存是AI推理的“阿喀琉斯之踵”?

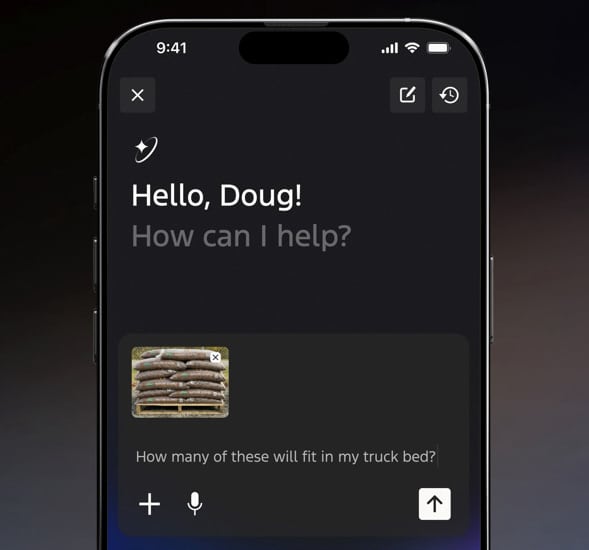

要理解TurboQuant的价值,必须了解当前大模型推理的痛点。当用户与ChatGPT等模型对话时,模型并非每次只思考一个字。为了保持对话的连贯性,它需要记住整个对话历史。这些历史信息就以键值对的形式存储在KV缓存中。

问题在于,这个缓存的大小与生成的序列长度成平方级增长关系。生成长文本或进行长对话时,KV缓存会消耗巨量的GPU显存,这不仅推高了云服务成本,也限制了单卡所能处理的并发请求数。因此,优化KV缓存被视为提升大模型商用可行性的关键技术路径之一。此前,行业已尝试过诸如窗口注意力(Window Attention)、稀疏注意力(Sparse Attention)等方法,但往往在压缩率和模型性能之间难以两全。TurboQuant宣称的“无损高压缩比”,正是在试图解决这一核心矛盾。

影响与局限:并非解决所有内存问题的“银弹”

尽管前景广阔,但市场消息也谨慎指出,TurboQuant目前仍是一项实验室阶段的突破,尚未进行大规模实际部署。其效果在复杂多变的真实生产环境中能否完全复现,仍有待验证。

更重要的是,该技术主要针对的是AI推理(Inference)阶段的内存瓶颈,而非模型训练(Training)。训练超大模型所需的海量GPU显存短缺问题,短期内仍将存在。因此,它不会完全解决由AI热潮引发的全球高端存储芯片短缺问题,但有望显著降低已训练模型部署和服务的门槛与成本。

行业展望:效率优化将成AI竞争新焦点

从AlphaGo到ChatGPT,AI竞赛的第一阶段主题是“性能突破”。而随着技术进入大规模应用深水区,第二阶段的核心正迅速转向“效率革命”。TurboQuant的出现,正是这一趋势的鲜明注脚。

未来,AI领域的竞争将不仅是模型能力的比拼,更是每美元算力所能提供的智能服务(Intelligence per Dollar)的较量。谁能以更低的成本、更少的资源消耗提供可靠的AI能力,谁就将在商业化和普及化中占据先机。从芯片设计(如专用AI推理芯片)、模型架构(如混合专家模型MoE),到算法优化(如TurboQuant),一场围绕AI全栈效率提升的军备竞赛已经全面展开。对于开发者和企业而言,这意味着更经济的API调用成本和更强大的本地部署可能,AI技术普惠的进程有望因此加速。

相关文章