一场围绕人工智能军事化应用的激烈法律与伦理对抗正在上演。最新行业动态指出,知名AI公司Anthropic已正式决定,将就美国国防部将其列为供应链风险(Supply Chain Risk)的决定提起诉讼。这一标签可能直接禁止该公司与五角大楼及其承包商合作,标志着科技巨头与政府机构在AI武器化、自主系统控制权等问题上的根本分歧已从幕后谈判走向公开法庭。

事件核心:一纸标签引发的全面对抗

市场消息显示,这场争议的导火索是国防部近期向Anthropic发出的一封正式信函,认定该公司构成供应链风险。Anthropic联合创始人兼CEO达里奥·阿莫迪(Dario Amodei)在随后发布的声明中,直指这一决定“在法律上站不住脚”,并明确表示将寻求司法途径解决。

阿莫迪在声明中划定了公司的核心原则底线:Anthropic的AI模型(特别是其旗舰产品Claude)不应被用于对美国民众的大规模监控,也不应被集成到完全自主的武器系统中。然而,据熟悉内情的人士透露,五角大楼方面则坚持认为,其AI供应商应允许其将技术用于“所有合法目的”,这一宽泛的定义显然与Anthropic的自我设限产生了不可调和的冲突。

法律攻防:供应链风险标签的效力与边界

作为法庭论战的前瞻,阿莫迪详细剖析了国防部决定的局限性。他强调,供应链风险机制的根本目的是“保护政府而非惩罚供应商”,相关法律要求国防部长必须采用“限制性最小的必要手段”来达成保护供应链的目标。

“即使对于国防部承包商而言,供应链风险标签也并不能(且不能)限制那些与其特定国防合同无关的Claude使用行为,或限制其与Anthropic的商业关系。”阿莫迪在声明中如此阐述其核心法律论点。

该公司披露,其绝大多数客户并不受此标签影响。该标签仅适用于客户将Claude直接作为其与国防部合同一部分的特定场景。这一定位旨在将争议范围收窄,避免对公司整体业务造成冲击。

风波背后:内部备忘录泄露与行业竞争暗流

这场公开对抗的升级,与一份内部备忘录的意外泄露密切相关。阿莫迪证实,在国防部发布标签决定、前总统在社交媒体宣布将Anthropic移出联邦系统、以及五角大楼随后宣布与OpenAI达成合作等一系列事件集中爆发的“艰难一天”里,他仓促撰写了一份内部通讯。

在这份被泄露的备忘录中,阿莫迪将竞争对手OpenAI与国防部的合作称为“安全表演秀”(Safety Theater)。他为此番激烈言辞道歉,称其并未反映自己“审慎或深思熟虑的观点”,并强调公司无意使局势升级。然而,这一插曲无疑加剧了双方谈判的紧张气氛,也揭示了AI行业头部公司在争取政府合同时的激烈竞争与理念差异。

值得注意的是,OpenAI已签署协议,接替Anthropic与国防部合作,这一举动在其内部员工中也引发了不小的反弹。这凸显了生成式AI公司普遍面临的困境:如何在追求商业增长、响应国家安全需求与坚守AI伦理原则之间取得平衡。

技术背景:为何AI供应链安全成为国防焦点?

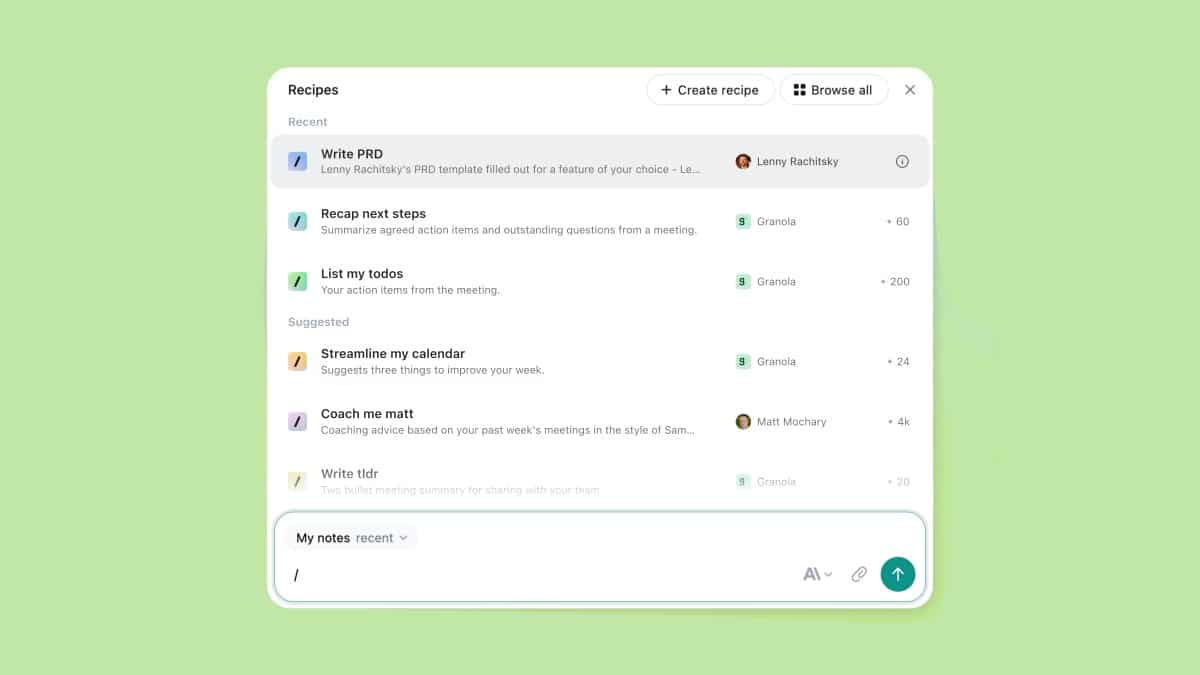

要理解这场争议的深层逻辑,必须了解AI供应链安全(AI Supply Chain Security)已成为大国战略竞争的核心领域。现代AI系统,尤其是大语言模型(LLM),其开发、训练、部署涉及复杂的数据、算力、算法和人才链条。国防部将AI供应商列为供应链风险,通常是基于以下担忧:

- 模型后门与数据投毒:担忧外国势力或恶意行为者通过在训练数据或模型中植入隐蔽后门,在关键时刻使系统失效或产生错误输出。

- 关键技术依赖:担心过度依赖单一或少数几家商业公司的AI技术,会在危机时形成“卡脖子”风险。

- 价值观对齐风险:担心AI公司的伦理准则(如Anthropic的“宪法AI”理念)与军事行动的即时性、保密性要求产生冲突,导致在关键时刻无法获得AI支持。

Anthropic以其对AI安全性(AI Safety)和可解释性(Interpretability)的深入研究而闻名,其Claude模型采用了“宪法AI”(Constitutional AI)训练框架,旨在让AI的行为遵循一套明文规定的原则。这套原则与无限制的军事应用之间存在天然的张力。

行业影响与未来展望:一场定义AI时代规则的标杆诉讼

这场即将到来的诉讼,其意义远超个案本身,它将为AI时代科技公司与政府的关系树立一个关键先例。

首先,它将检验政府在“国家安全”名义下对商业AI技术施加限制的边界。法律专家指出,相关法律赋予了五角大楼在国家安全事务上的广泛自由裁量权,法院传统上不愿在此类问题上轻易否决政府的判断。前白宫AI顾问迪恩·鲍尔(Dean Ball)评论道:“法院非常不愿意在什么是国家安全问题上对政府进行事后评判……要推翻这一点,门槛非常高,但并非不可能。”Anthropic的挑战正在于如何跨越这一“高门槛”。

其次,它将影响全球AI公司的商业模式选择。如果Anthropic败诉,意味着坚持严格自我设限的AI公司可能被排除在利润丰厚的政府市场之外。反之,如果Anthropic成功限制了“供应链风险”标签的适用范围,将为其他拥有类似伦理关切的公司提供法律盾牌,鼓励行业分化——一部分公司专注于无限制的商业与政府应用,另一部分则主打“安全、可信、可控”的差异化路线。

最后,它关乎AI技术发展的根本方向。阿莫迪在声明结尾强调,公司的首要任务是确保在持续的重大作战行动中,美国士兵和国家安全专家仍能获得重要工具。Anthropic目前仍在以“名义成本”为国防部的某些行动(如涉及伊朗的行动)提供模型支持。这表明,纯粹的“不合作”并非选项,真正的博弈点在于“如何合作”以及“在什么规则下合作”。

这场诉讼无论结果如何,都将是AI技术融入现代社会核心功能进程中的一个里程碑。它迫使整个行业思考:当AI的能力足以影响国家安全和战争形态时,其开发者和使用者各自的权利、责任与边界究竟在哪里?这场在华盛顿法庭上演的辩论,答案或将定义未来十年的AI格局。

相关文章