当企业试图将前沿大语言模型(Large Language Models, LLMs)投入实际应用时,高昂的算力成本和庞大的模型体积成为难以逾越的障碍。如今,这一行业痛点正迎来新的解决方案。最新行业动态指出,一种名为CompactifAI的模型压缩技术正崭露头角,其最新成果——一个经过深度压缩的60B参数模型,已面向开发者免费开放。这不仅意味着企业部署AI的门槛有望大幅降低,也预示着模型小型化与高效化竞赛进入新阶段。

技术核心:源自量子灵感的模型压缩术

市场消息显示,这项突破的核心在于CompactifAI压缩技术。该技术并非传统的剪枝或量化方法,其设计灵感据称借鉴了量子计算中的某些原理,旨在以更精简的参数量,逼近甚至达到原始大型模型的性能。此次发布的HyperNova 60B 2602版本模型,体积被压缩至约32GB,据称仅为某些同级别开源模型的一半大小。

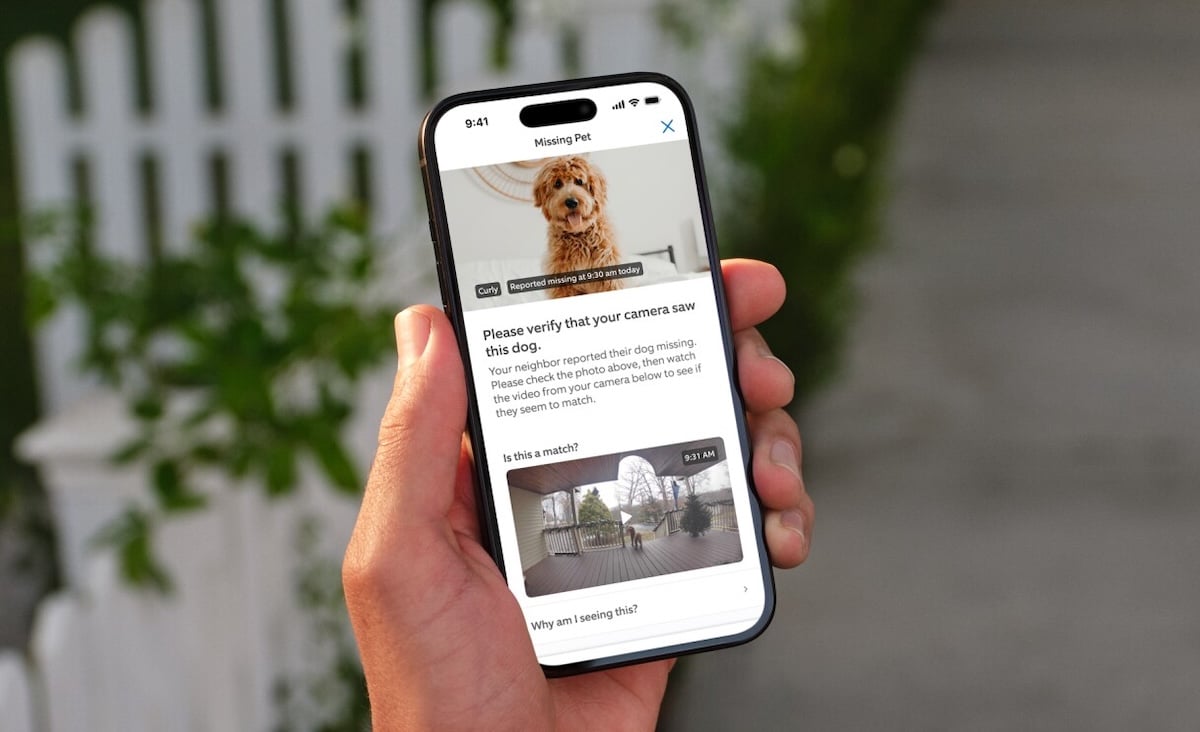

更关键的性能指标在于,压缩后的模型在保持高准确度的同时,显著降低了内存占用和推理延迟。对于需要实时响应的应用场景,如智能客服或代码生成助手,这至关重要。该公司在一份最新文件中披露,新版本模型增强了对工具调用(Tool Calling)和智能体编码(Agentic Coding)的支持,而这些功能通常在未压缩的大型模型中会产生极高的推理成本。

市场定位:欧洲AI势力的成本突围

这场技术竞赛的背后,是欧洲AI初创公司寻求差异化生存空间的战略布局。与动辄需要数千亿参数和天价算力支撑的“巨无霸”模型不同,以高效、实用、可负担为核心的模型压缩路线,正成为挑战美国科技巨头主导权的一条蹊径。

据熟悉内情的人士透露,提供该压缩技术的公司已将其定位为能够提供“全AI技术栈的自主解决方案”的供应商,这一表述带有明显的技术主权色彩。其企业客户名单中已包括能源、汽车制造和金融领域的知名机构,显示出该技术路线在垂直行业中的初步认可。此外,该公司与西班牙地方政府的合作,以及此前获得公共技术转型机构的投资,都印证了其发展路径与地缘政治及区域产业政策紧密相连。

行业影响:开源与商业化并行的未来

此次免费开放模型,可被视为一次重要的市场策略。通过降低开发者的试用门槛,快速建立开发者生态和用户口碑,为后续的商业化铺路。该公司计划在2026年开源更多压缩模型,以支持更广泛的应用场景,这进一步明确了其通过开源社区驱动技术采纳和标准制定的意图。

从行业角度看,模型压缩技术的成熟将产生深远影响:首先,它将极大推动AI在边缘设备、物联网和移动端的部署,开启真正的普惠AI时代。其次,它可能重塑云服务商的商业模式,从单纯提供算力转向提供优化后的高效模型服务。最后,这为众多资金并不充裕的中小企业和研究机构提供了接触先进AI能力的机会,可能激发新一轮的应用创新浪潮。

尽管前方的道路依然漫长,且需要面对来自其他专注模型效率的竞争对手(如法国的Mistral AI等)的挑战,但此次技术发布无疑为“大模型不一定等于好模型”的实用主义路线增添了有力注脚。在追求参数规模之外,对效率、成本和可部署性的极致优化,正成为AI技术民主化进程中不可或缺的一环。

相关文章